Révolution ! D’aucuns qualifient ainsi depuis quelques années l’impact du numérique sur l’économie et la société dans son ensemble. Pourquoi pas. Bien que son avènement ne soit pas tout à fait nouveau. C’est toutefois l’extension désormais globale et massive de ses usages qui donne crédit au propos. Comme naguère le feu, la roue ou l’électricité, le numérique ne se cantonne pas à un seul secteur mais les irrigue tous… donnant naissance à moultes innovations. En médecine, comme en comptabilité ! Car ses usages permettent de répondre mieux et plus vite à de réelles attentes.

Plus précisément, s’agissant de médecine, quelle est l’attente : vivre longtemps et en bonne santé. Repousser la mort… n’est-ce pas d’ailleurs l’une des ambitions affichées des créateurs de Google ? Le numérique y trouve là son terrain de prédilection¹.

Pour autant, cet usage doit-il se faire frénétiquement, sans discernement, sur la foi aveugle des bienfaits du progrès technique ?

C’est ce contre quoi des chercheurs de la prestigieuse école de médecine de Standford viennent nous mettre en garde.

Dans un article publié le 15 mars 2018 dans la revue The New England Journal of Medicine², Danton S. Char, Nigam H. Shah, et David Magnus, affirment tout d’abord les potentiels bénéfices que représente le machine learning pour diagnostiquer et soigner³. Et, par conséquent, la société de faire pression pour une utilisation toujours plus large et rapide des dernières innovations. Mais dans le même temps, les auteurs alertent sur un recours aveugle à ces nouveaux outils et sur la nécessité d’une utilisation éthique pour en éviter les pièges. De quelles natures ?

Partager les objectifs de l’algorithme

Le premier tient aux objectifs poursuivis par le concepteur de l’algorithme ou son donneur d’ordre. Ce sont eux qui sous-tendent diagnostic et préconisation de traitement. Mais de ces objectifs, le professionnel de santé en a-t-il toujours une parfaite connaissance ? Sont-ils partagés entre programmeur, donneur d’ordre et médecin ? Et ainsi, à titre d’illustration, de faire référence à l’algorithme employé par Volkswagen pour réduire les émissions d’oxyde d’azote durant les tests.

« Que se passerait-il si l’algorithme introduisait un objectif d’économie ? Ou si la préconisation de traitement dépendait de l’assurance ou de la capacité contributive du patient ? » David Magnus, chercheur, université de Stanford.

Car on ne peut ignorer les tensions existant entre différents objectifs que sont, notamment, la maximisation du profit d’un opérateur de santé et la sauvegarde de la santé du patient.

Ainsi, les praticiens doivent-ils toujours comprendre comment l’algorithme a été créé, pouvoir évaluer les données permettant d’établir les bases statistiques nécessaires à la préconisation, connaitre les principes de fonctionnement du modèle et se garder d’en devenir totalement dépendant. A défaut, cela reviendrait à utiliser un système de machine learning comme une boîte noire, susceptible de produire des résultats éthiquement douteux voire problématiques.

Expérience clinique du praticien et facteur humain

Les auteurs s’inquiètent ensuite d’un risque d’automatisation et de désincarnation d’un système où les données médicales des patients viennent alimenter une base de données collective pouvant comporter certains biais. Avec, en retour, le risque d’un usage par le praticien sans tenir compte de sa propre expérience clinique et de l’aspect humain de la situation.

Ainsi, le professionnel de santé doit-il conserver en toute circonstance une analyse critique en confrontant le diagnostic à sa propre expérience clinique. Et d’illustrer le propos en utilisant l’exemple de naissances prématurées ou de lésions au cerveau. Ainsi, si les cliniciens cessent toujours les traitements dans ces cas de figure, le système pourrait en déduire un diagnostic systématiquement fatal, sans tenir compte des circonstances particulières au cas examiné.

Pour autant, un modèle correctement maîtrisé pourrait améliorer le système de santé en permettant d’identifier les données biaisées ou les sujets sur lesquels, en raison d’un manque de données, il serait souhaitable de procéder à des recherches. Et David Magnus de prendre pour exemple un algorithme actuellement développé à Stanford, en parfaite intelligence entre les chercheurs et les programmeurs, pour mieux prédire les besoins en soins palliatifs.

Responsabilité et confidentialité

Enfin, l’introduction d’un troisième acteur – l’algorithme – entre le praticien et son patient est susceptible de changer la relation, modifiant la dynamique de responsabilité⁴ et posant des questions de confidentialité à laquelle peut prétendre le patient.

Sujet d’autant plus délicat que le patient doit, pour bénéficier des avantages promis par l’assistance numérique, consentir à l’enregistrement de ses données. Avec d’autant plus d’acuité dans le domaine en fort développement de la génétique et du séquençage.

Quels enseignements pour les professionnels de la comptabilité ?

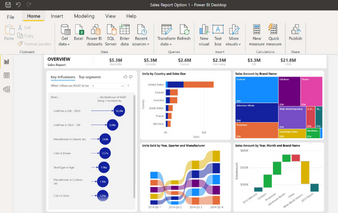

Autant de questions posées qui viennent utilement tempérer une foi immodérée placée dans l’IA. Des questions qui, invariablement, se posent à l’ensemble des techniques utilisant des algorithmes. Dont les professionnels de la comptabilité.

Des professionnels qui, soumis à une déontologie préexistante, trouvent désormais à se questionner sur leur propre capacité à maîtriser la conformité, dès lors qu’intervient entre eux et leur client, ce tiers que figure désormais l’algorithme apprenant. Indépendance, compétence – impartialité au cas particulier du commissaire aux comptes – secret professionnel ou encore confidentialité… Les professionnels ne peuvent perdre le contrôle intellectuel des diligences qu’ils délivrent et facturent à leur client. Et qu’en est-il du rapport de responsabilité ? D’autres principes éthiques émergeront-ils de cette nouvelle donne ?

Il est en tous les cas une règle de comportement professionnel propre au commissaire aux comptes, qui trouvera certainement à s’étendre : le scepticisme dont il doit faire preuve à l’égard de toutes les informations qui lui sont fournies pour réaliser sa mission.

Penser cette nouvelle configuration… tel est l’objet du LAB 50 créé par la compagnie des commissaires aux comptes de Paris et l’Ordre des experts-comptables Paris Ile-de-France.

(Ethique à Hypocrate : En référence à l’œuvre d’Aristote, Ethique à Nicomaque.)

Notes

Voir également l’excellente publication de Léa Ganalopoulo, « des logiciels experts en diagnostic médical », le Journal du CNRS, février 2018